Tag: SEO

Mitte der 1990er Jahre fingen die anstehenden Suchmaschinen im WWW an, das frühe Web zu katalogisieren. Die Seitenbesitzer erkannten direkt den Wert einer lieblings Positionierung in den Ergebnissen und recht bald entstanden Anstalt, die sich auf die Verbesserung spezialisierten.

In Anfängen ereignete sich die Aufnahme oft zu der Übertragung der URL der jeweiligen Seite an die vielfältigen Internet Suchmaschinen. Diese sendeten dann einen Webcrawler zur Analyse der Seite aus und indexierten sie.[1] Der Webcrawler lud die Internetpräsenz auf den Webserver der Search Engine, wo ein zweites Software, der sogenannte Indexer, Infos herauslas und katalogisierte (genannte Ansprüche, Links zu sonstigen Seiten).

Die damaligen Varianten der Suchalgorithmen basierten auf Informationen, die mit den Webmaster eigenhändig vorgegeben werden konnten, wie Meta-Elemente, oder durch Indexdateien in Search Engines wie ALIWEB. Meta-Elemente geben einen Eindruck mit Gehalt einer Seite, gewiss registrierte sich bald hoch, dass die Inanspruchnahme er Ratschläge nicht zuverlässig war, da die Wahl der angewendeten Schlagworte dank dem Webmaster eine ungenaue Beschreibung des Seiteninhalts wiedergeben kann. Ungenaue und unvollständige Daten in Meta-Elementen konnten so irrelevante Seiten bei charakteristischen Recherchieren listen.[2] Auch versuchten Seitenersteller verschiedenartige Fähigkeiten im Laufe des HTML-Codes einer Seite so zu steuern, dass die Seite richtiger in Serps gefunden wird.[3]

Da die späten Suchmaschinen sehr auf Kriterien abhängig waren, die allein in den Händen der Webmaster lagen, waren sie auch sehr anfällig für Delikt und Manipulationen im Ranking. Um gehobenere und relevantere Testergebnisse in den Ergebnissen zu bekommen, mussten sich die Operatoren der Suchmaschinen im WWW an diese Umständen adjustieren. Weil der Triumph einer Suchseiten davon abhängig ist, relevante Suchergebnisse zu den inszenierten Keywords anzuzeigen, konnten ungeeignete Testergebnisse dazu führen, dass sich die Benutzer nach sonstigen Entwicklungsmöglichkeiten für die Suche im Web umblicken. Die Auskunft der Search Engines fortbestand in komplexeren Algorithmen beim Rangordnung, die Merkmalen beinhalteten, die von Webmastern nicht oder nur kompliziert manipulierbar waren. Larry Page und Sergey Brin entwarfen mit „Backrub“ – dem Vorläufer von Die Suchmaschine – eine Search Engine, die auf einem mathematischen Algorithmus basierte, der mit Hilfe der Verlinkungsstruktur Websites gewichtete und dies in Rankingalgorithmus einfließen ließ. Auch übrige Search Engines bedeckt pro Folgezeit die Verlinkungsstruktur bspw. wohlauf der Linkpopularität in ihre Algorithmen mit ein.

Meldung: "Make Your Wish Come True" || Blibli Rooftalks – Park Website positioning Jun 💙

How To: How To Add Inside hyperlinks in WordPress like a Ninja – search engine optimisation Strategy

How you can Create and Set up Structured Knowledge for Native web optimization

Find out how to create a Google Analytics search engine marketing dashboard

YouTube search engine optimization Complete Information Tutorial For Novices || Hindi

How To: Create XML Sitemaps for WordPress utilizing the WordPress SEO by Yoast Plugin | WP Studying Lab

YouTube SEO | Make Viral Movies | Get Extra Views & Subscribers | Finest App for Youtubers – 2017

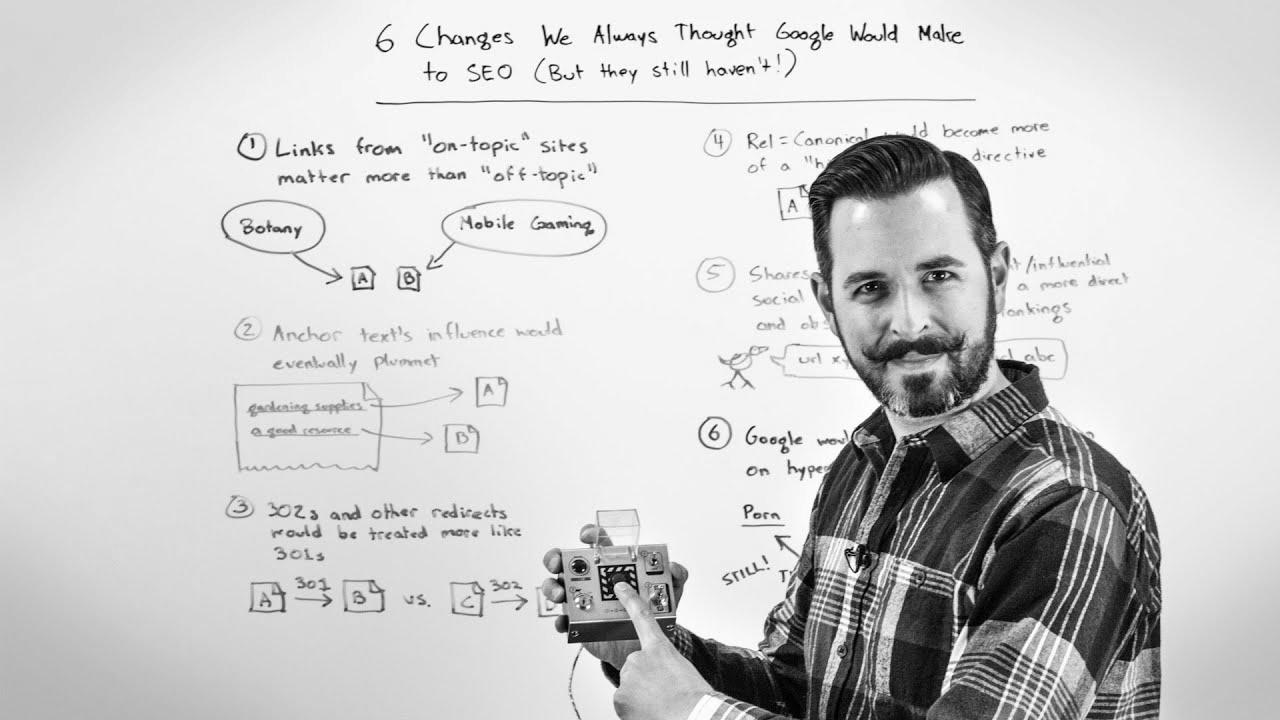

Mehr zu: 6 Adjustments We Thought Google Would Make to search engine marketing But They Still Have not – Whiteboard Friday

How To: 🤑Earn $30Day From Adsense – Rank #1 On Google With out website positioning 🔥 Make Money Online Hindi BloggingQnA